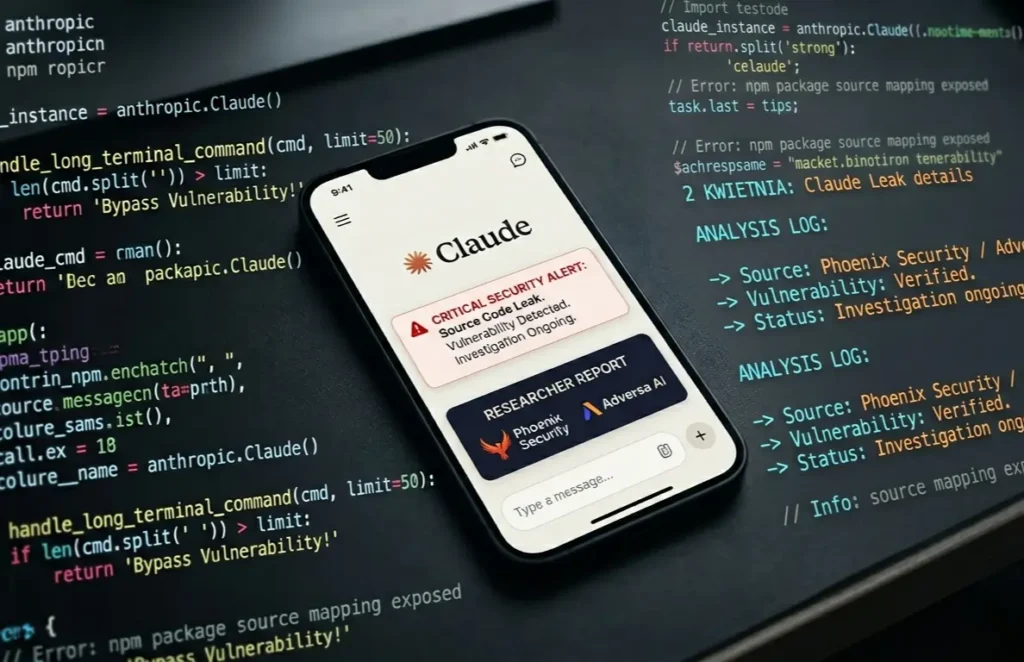

Dokładnie 31 marca 2026 roku społeczność technologiczna wstrzymała oddech, gdy firma Anthropic przypadkowo ujawniła pełny kod źródłowy swojego flagowego asystenta programistycznego, Claude Code. Jak informowaliśmy o tym wycieku 2 kwietnia, zdarzenie to nie było wynikiem zaawansowanego ataku hakerskiego, lecz fatalnego błędu ludzkiego podczas rutynowej aktualizacji oprogramowania.

Przez zwykłą pomyłkę opublikowano plik mapowania źródłowego o rozmiarze blisko sześćdziesięciu megabajtów w publicznym repozytorium pakietów npm. W efekcie tego niedopatrzenia, ponad pół miliona linii tajnego kodu trafiło bezpośrednio do rąk niezależnych deweloperów oraz cyberprzestępców na całym świecie.

Sytuacja ta błyskawicznie obnażyła skomplikowaną architekturę tego potężnego narzędzia, jego ukryte mechanizmy obronne i fundamentalne luki w zabezpieczeniach. Dla całego sektora IT to absolutne trzęsienie ziemi, które stawia pod znakiem zapytania rzekome bezpieczeństwo zamkniętych systemów sztucznej inteligencji.

Ominięcie zabezpieczeń i wstrzykiwanie kodu

Zgodnie z naszymi wcześniejszymi przewidywaniami, niezależni analitycy bezpieczeństwa zaczęli błyskawicznie i wnikliwie analizować udostępnione dane źródłowe. Badacze z firmy Phoenix Security natychmiast odkryli trzy krytyczne podatności pozwalające na wstrzykiwanie złośliwych poleceń. To potężne zagrożenie otwiera hakerom szeroką furtkę do kradzieży poufnych danych uwierzytelniających bezpośrednio z maszyn twórców oprogramowania. J

eszcze bardziej szokujące okazały się ustalenia zespołu Adversa AI, którzy udowodnili bezsprzecznie, że system zabezpieczeń Claude Code można całkowicie ominąć, jeśli polecenie w terminalu zawiera ponad pięćdziesiąt subkomend. Powód tego rażącego błędu był niezwykle prozaiczny. Anthropic nałożył ten sztuczny limit wyłącznie po to, aby ograniczyć wysokie koszty analizy bezpieczeństwa opartej na tokenach.

W praktyce oznacza to, że wystarczy jedno odpowiednio spreparowane, bardzo długie polecenie w pliku konfiguracyjnym projektu, aby sztuczna inteligencja zignorowała wszelkie zasady i bezszelestnie wykonała szkodliwy skrypt.

Realne zagrożenie dla rodzimego rynku IT

Polski rynek technologiczny, będący obecnie jednym z kluczowych ośrodków wytwarzania oprogramowania w Europie, musi potraktować ten bezprecedensowy incydent ze szczególną ostrożnością. Wiele naszych rodzimych firm oraz krakowskich czy warszawskich startupów niezwykle chętnie wdraża najnowsze narzędzia oparte na AI.

Niestety, cyberprzestępcy już teraz wykorzystują ten głośny wyciek jako idealną przynętę, masowo rozsiewając w sieci fałszywe wersje narzędzia. Dla polskiego programisty, szukającego oszczędności przy kosztach licencji sięgających nierzadko kilkuset złotych miesięcznie, wizja darmowej wersji pobranej z forum dyskusyjnego bywa niezwykle kusząca.

Trzeba jednak głośno powiedzieć, że instalowanie niezweryfikowanych paczek z GitHuba naraża całe firmowe sieci na infekcje oprogramowaniem kradnącym dane. Koszty takiej lekkomyślności obejmują nie tylko całkowity paraliż lokalnego software house’u, ale też gigantyczne kary z tytułu naruszenia przepisów RODO, wynoszące miliony złotych w przypadku wycieku danych europejskich klientów.

Koniec ślepego zaufania do inteligentnych asystentów

Ten spektakularny i kosztowny incydent bezpieczeństwa dobitnie udowadnia, że ochrona zautomatyzowanych systemów jest wciąż na niezwykle wczesnym etapie rozwoju. Nawet najwięksi giganci z Doliny Krzemowej popełniają kardynalne błędy operacyjne, a chęć minimalizacji kosztów przetwarzania danych nierzadko wygrywa z rygorystycznymi procedurami ochrony użytkownika końcowego.

Zgodnie z wytycznymi ekspertów ds. cyberbezpieczeństwa, polskie organizacje muszą natychmiast przestać bezgranicznie ufać inteligentnym asystentom i niezwłocznie wdrożyć architekturę zerowego zaufania we własnych środowiskach programistycznych. Omawiany wyciek to bez wątpienia potężna lekcja dla całej globalnej branży, jasno przypominająca, że w nowej erze zautomatyzowanego kodowania wykwalifikowany człowiek nadal musi stanowić ostatnią, najważniejszą barierę ochronną.